Hoje, mais de 5.19 bilhões de pessoas exploram a Internet. É um público vasto, não é?

O grande volume de conteúdo gerado na internet é simplesmente impressionante. Desde atualizações nas redes sociais e publicações em blogs até comentários gerados por utilizadores e carregamentos multimédia, o mundo online é um repositório vasto e dinâmico de informação.

No entanto, nem todo conteúdo é bom. Alguns podem ofender vários grupos devido à idade, raça, sexo, nacionalidade ou etnia. Esse conteúdo precisa de uma observação cuidadosa. Isso garante paz e harmonia para todos.

Conseqüentemente, surge a necessidade premente de moderação de conteúdo. Embora a revisão manual seja eficaz, existem certas limitações que não podemos ignorar. E é aí que entra a moderação automatizada de conteúdo como uma solução eficaz. Este método eficiente garante experiências online seguras e protege os usuários de possíveis danos.

Neste artigo, falaremos sobre os benefícios inestimáveis e os diversos tipos disponíveis em ferramentas de moderação automatizadas (pré-treinadas com conjuntos de dados robustos).

Compreendendo a moderação automatizada de conteúdo

A moderação automatizada de conteúdo usa tecnologia para supervisionar e gerenciar o conteúdo gerado pelo usuário. Em vez de humanos escaneando cada postagem, algoritmos e aprendizado de máquina fazem o trabalho pesado. Eles identificam rapidamente conteúdo prejudicial ou impróprio. Esses sistemas aprendem com vastos conjuntos de dados e tomam decisões com base em critérios pré-treinados com humanos.

Métodos automatizados de moderação de conteúdo podem ser altamente eficientes. Eles trabalham XNUMX horas por dia e analisam instantaneamente grandes volumes de conteúdo. No entanto, eles também complementam os revisores humanos. Às vezes, um toque humano é essencial para o contexto. Essa combinação garante espaços online mais seguros à medida que os usuários obtêm o melhor dos dois mundos.

Quer uma plataforma livre de conteúdo prejudicial? A moderação automatizada de conteúdo é o caminho a seguir. Deixaremos isso mais claro à medida que você ler os tipos e benefícios abaixo.

[Leia também: O guia necessário para moderação de conteúdo]

Tipos de moderação automatizada

A moderação automatizada de conteúdo evoluiu consideravelmente ao longo dos anos. Agora incorpora um espectro de tecnologias e abordagens, cada uma projetada para atender a necessidades específicas. Aqui está uma visão mais detalhada dos diferentes tipos:

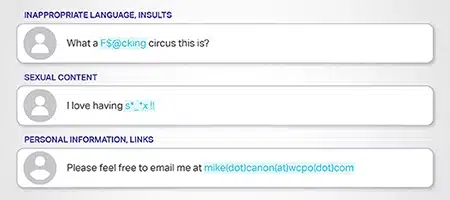

Moderação baseada em palavras-chave

Este método funciona em listas predefinidas de palavras banidas ou sinalizadas. Quando o conteúdo contém essas palavras, o sistema nega sua publicação ou o envia para revisão. Por exemplo, as plataformas podem bloquear linguagem explícita ou termos ligados ao discurso de ódio.

Moderação de reconhecimento de imagem

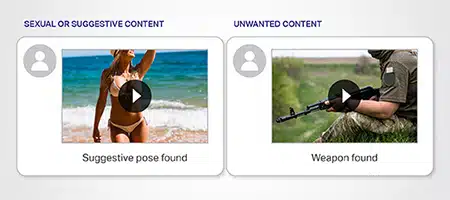

Aproveitando o poder do aprendizado de máquina, esse método identifica imagens inadequadas ou sinalizadas. Ele pode detectar recursos visuais que promovam violência, conteúdo explícito ou materiais protegidos por direitos autorais. Algoritmos avançados analisam padrões visuais para garantir que nenhuma imagem prejudicial passe despercebida.

Moderação de análise de vídeo

Semelhante ao reconhecimento de imagem, a análise de vídeo divide os componentes do vídeo quadro a quadro. Ele verifica recursos visuais, sinais de áudio inadequados ou conteúdo sinalizado. É inestimável em plataformas como o YouTube, onde o conteúdo de vídeo domina.Moderação de análise de sentimento

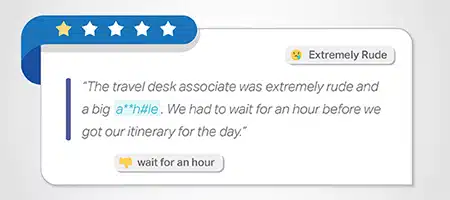

Compreender o sentimento ou emoção por trás do conteúdo é vital. Este método avalia o tom do conteúdo e sinaliza conteúdo excessivamente negativo, que promove ódio ou promove sentimentos prejudiciais. É particularmente útil em fóruns ou plataformas que promovem interações comunitárias positivas.

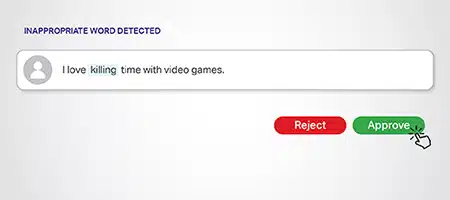

Moderação Contextual

O conteúdo geralmente requer contexto para uma moderação precisa. Este método avalia o conteúdo dentro do contexto circundante. Ele garante que o conteúdo genuíno, mesmo com palavras sinalizadas, não seja bloqueado indevidamente se o contexto geral for inofensivo. No exemplo – contém a palavra ‘matar’, no contexto, é benigno, referindo-se à atividade inofensiva de jogar

Moderação baseada na reputação do usuário

Os usuários com histórico de violação das diretrizes podem exigir um exame mais minucioso. Este sistema modera com base na reputação do usuário. Aqueles com infrações anteriores podem ter seu conteúdo revisado com mais rigor do que aqueles com uma ficha limpa.

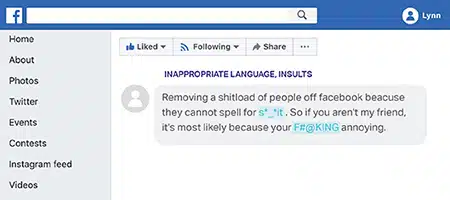

Moderação de monitoramento de mídia social

Dado o vasto conteúdo gerado nas redes sociais, ferramentas especializadas monitoram essas plataformas. Eles detectam possíveis problemas como desinformação, notícias falsas ou trollagem em tempo real. Ajuda a criar um ambiente de mídia social mais limpo e seguro.

Benefícios da moderação automatizada

A automação traz vários benefícios junto com ela. Vamos dar uma olhada mais de perto nos benefícios que a moderação automatizada de conteúdo oferece:

Filtragem de conteúdo eficiente

Com o aumento do conteúdo gerado pelo usuário (UGC), as plataformas precisam de sistemas para filtrar grandes quantidades. Ofertas automatizadas de moderação de conteúdo filtragem de conteúdo eficiente. Garante que apenas materiais apropriados vejam a luz do dia.

Segurança digital aprimorada

A segurança online é importante para aumentar a confiança dos usuários no uso da internet. A automação ajuda a manter a segurança digital ao detectar conteúdo prejudicial. Do discurso de ódio ao assédio online, mantém tais ameaças afastadas.

Aderência às Diretrizes da Comunidade

As diretrizes da comunidade mantêm a integridade da plataforma. A automação garante que essas regras não sejam violadas e ajuda a criar espaços online harmoniosos.

Combate ao assédio online e ao discurso de ódio

Os sistemas automatizados podem identificar e eliminar rapidamente o assédio online e o discurso de ódio. Eles garantem que as plataformas permaneçam acolhedoras e seguras, sinalizando conteúdos nocivos.

Combater a desinformação e as notícias falsas

Na idade de desinformação desenfreada, a automação desempenha um papel fundamental. Ele detecta e suprime desinformação/notícias falsas para defender a verdade e a precisão.

Enfrentando a trollagem

Trolling pode arruinar diálogos online e atrapalhar conversas significativas. A moderação automatizada de conteúdo identifica esses trolls e ajuda a manter um ambiente positivo. Imagine uma sala de aula. A TI atua como uma força cautelosa que promove interações construtivas e proporciona aos usuários uma experiência melhor.

Análise aprofundada

A análise de texto vai além da mera detecção de palavras-chave. Ele compreende o contexto e promove conteúdo genuíno, ao mesmo tempo que remove narrativas prejudiciais. Além dos textos, as ferramentas de reconhecimento de imagens detectam imagens inadequadas. Eles garantem que as imagens estejam alinhadas com os padrões da plataforma.

Moderação de vídeo abrangente

O conteúdo de vídeo domina o espaço digital, pois as pessoas adoram recursos visuais envolventes. A automação intervém para garantir que esses vídeos cumpram padrões específicos. Ele analisa grandes volumes de conteúdo, detecta elementos prejudiciais e os remove imediatamente.

Conclusão

A moderação automatizada de conteúdo apresenta benefícios e desafios. É excelente na remoção de conteúdo impróprio de plataformas digitais. No entanto, também enfrenta limitações e suscita debates sobre a censura e o papel da tecnologia. Em muitos casos, a moderação especializada de seres humanos também é necessária em caso de ambiguidade.

As plataformas devem ser claras sobre as regras de moderação. Eles também precisam de sistemas para que os usuários contestem as decisões de remoção de conteúdo por questões de justiça e precisão. Com o equilíbrio certo, podemos alcançar justiça para os utilizadores online, mantendo a sua segurança e defendendo os seus direitos.

Este método funciona em listas predefinidas de palavras banidas ou sinalizadas. Quando o conteúdo contém essas palavras, o sistema nega sua publicação ou o envia para revisão. Por exemplo, as plataformas podem bloquear linguagem explícita ou termos ligados ao discurso de ódio.

Este método funciona em listas predefinidas de palavras banidas ou sinalizadas. Quando o conteúdo contém essas palavras, o sistema nega sua publicação ou o envia para revisão. Por exemplo, as plataformas podem bloquear linguagem explícita ou termos ligados ao discurso de ódio. Aproveitando o poder do aprendizado de máquina, esse método identifica imagens inadequadas ou sinalizadas. Ele pode detectar recursos visuais que promovam violência, conteúdo explícito ou materiais protegidos por direitos autorais. Algoritmos avançados analisam padrões visuais para garantir que nenhuma imagem prejudicial passe despercebida.

Aproveitando o poder do aprendizado de máquina, esse método identifica imagens inadequadas ou sinalizadas. Ele pode detectar recursos visuais que promovam violência, conteúdo explícito ou materiais protegidos por direitos autorais. Algoritmos avançados analisam padrões visuais para garantir que nenhuma imagem prejudicial passe despercebida.

Compreender o sentimento ou emoção por trás do conteúdo é vital. Este método avalia o tom do conteúdo e sinaliza conteúdo excessivamente negativo, que promove ódio ou promove sentimentos prejudiciais. É particularmente útil em fóruns ou plataformas que promovem interações comunitárias positivas.

Compreender o sentimento ou emoção por trás do conteúdo é vital. Este método avalia o tom do conteúdo e sinaliza conteúdo excessivamente negativo, que promove ódio ou promove sentimentos prejudiciais. É particularmente útil em fóruns ou plataformas que promovem interações comunitárias positivas. O conteúdo geralmente requer contexto para uma moderação precisa. Este método avalia o conteúdo dentro do contexto circundante. Ele garante que o conteúdo genuíno, mesmo com palavras sinalizadas, não seja bloqueado indevidamente se o contexto geral for inofensivo. No exemplo – contém a palavra ‘matar’, no contexto, é benigno, referindo-se à atividade inofensiva de jogar

O conteúdo geralmente requer contexto para uma moderação precisa. Este método avalia o conteúdo dentro do contexto circundante. Ele garante que o conteúdo genuíno, mesmo com palavras sinalizadas, não seja bloqueado indevidamente se o contexto geral for inofensivo. No exemplo – contém a palavra ‘matar’, no contexto, é benigno, referindo-se à atividade inofensiva de jogar Os usuários com histórico de violação das diretrizes podem exigir um exame mais minucioso. Este sistema modera com base na reputação do usuário. Aqueles com infrações anteriores podem ter seu conteúdo revisado com mais rigor do que aqueles com uma ficha limpa.

Os usuários com histórico de violação das diretrizes podem exigir um exame mais minucioso. Este sistema modera com base na reputação do usuário. Aqueles com infrações anteriores podem ter seu conteúdo revisado com mais rigor do que aqueles com uma ficha limpa. Dado o vasto conteúdo gerado nas redes sociais, ferramentas especializadas monitoram essas plataformas. Eles detectam possíveis problemas como desinformação, notícias falsas ou trollagem em tempo real. Ajuda a criar um ambiente de mídia social mais limpo e seguro.

Dado o vasto conteúdo gerado nas redes sociais, ferramentas especializadas monitoram essas plataformas. Eles detectam possíveis problemas como desinformação, notícias falsas ou trollagem em tempo real. Ajuda a criar um ambiente de mídia social mais limpo e seguro.