Estudo de caso: moderação de conteúdo

Mais de 30 mil documentos da Web descartados e anotados para moderação de conteúdo

que se esforçam para proteger o espaço online onde nos conectamos e nos comunicamos.

À medida que o uso da mídia social continua a crescer, o

O problema do cyberbullying surgiu como um

obstáculo significativo para plataformas que se esforçam para

garantir um espaço online seguro. Um espantoso

38% dos indivíduos encontram isso

conduta prejudicial em uma base diária,

enfatizando a demanda urgente por

abordagens de moderação de conteúdo.

As organizações hoje contam com o uso de

inteligência artificial para lidar com os problemas duradouros

problema de cyberbullying proativamente.

Cíber segurança:

O relatório de aplicação de padrões da comunidade do quarto trimestre do Facebook revelou – ação em 4 milhões de conteúdos de bullying e assédio, com uma taxa de detecção proativa de 6.3%

Educação:

A 2021 estudo descobriu que 36.5%% dos estudantes nos estados unidos entre as idades de 12 & 17 anos experimentaram cyberbullying em um ponto ou outro durante sua escolaridade.

De acordo com um relatório de 2020, o mercado global de soluções de moderação de conteúdo foi avaliado em US$ 4.07 bilhões em 2019 e deve atingir US$ 11.94 bilhões até 2027, com um CAGR de 14.7%.

Solução do mundo real

Dados que moderam conversas globais

O cliente estava desenvolvendo um sistema automatizado robusto

moderação de conteúdo Machine Learning

modelo para sua oferta de nuvem, para a qual eles

estavam procurando um fornecedor específico de domínio que

poderia ajudá-los com dados de treinamento precisos.

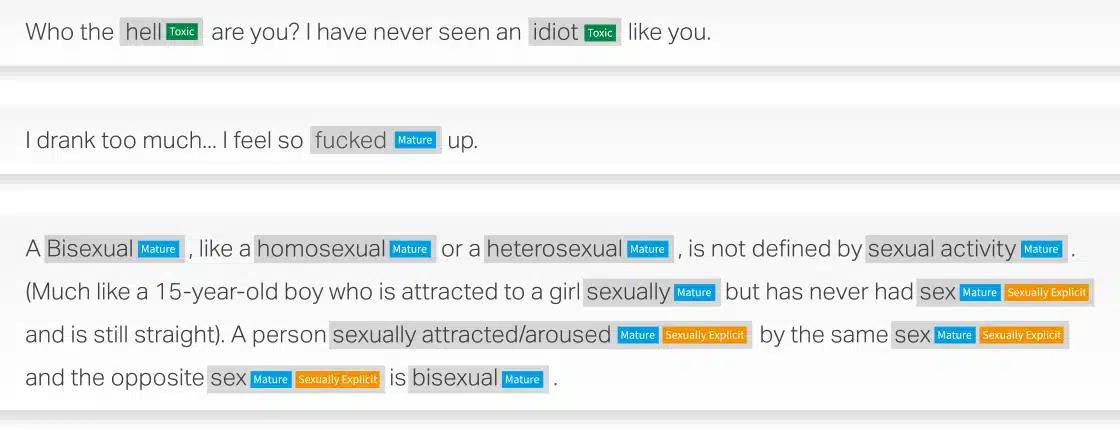

Aproveitando nosso amplo conhecimento em processamento de linguagem natural (NLP), ajudamos o cliente a reunir, categorizar e anotar mais de 30,000 documentos em inglês e espanhol para criar moderação de conteúdo automatizada Modelo de aprendizado de máquina bifurcado em conteúdo tóxico, adulto ou sexualmente explícito categorias.

Problema

- Web scraping de 30,000 documentos em espanhol e inglês de domínios priorizados

- Categorizando o conteúdo reunido em segmentos curtos, médios e longos

- Rotular os dados compilados como conteúdo tóxico, adulto ou sexualmente explícito

- Garantindo anotações de alta qualidade com um mínimo de 90% de precisão.

Solução

- Web Scrapped 30,000 documentos cada um para espanhol e inglês de BFSI, Saúde, Manufatura, Varejo. O conteúdo foi ainda bifurcado em documentos curtos, médios e longos

- Rotular com sucesso o conteúdo classificado como conteúdo tóxico, adulto ou sexualmente explícito

- Para atingir 90% de qualidade, a Shaip implementou um processo de controle de qualidade em dois níveis:

» Nível 1: Quality Assurance Check: 100% dos arquivos a serem validados.

» Nível 2: Verificação de Análise de Qualidade Crítica: Equipe CQA da Shaips para avaliar 15%-20% das amostras retrospectivas.

Resultado

Os dados de treinamento ajudaram na construção de um modelo de ML de moderação de conteúdo automatizado que pode produzir vários resultados benéficos para manter um ambiente online mais seguro. Alguns dos principais resultados incluem:

- Eficiência para processar grande quantidade de dados

- Consistência em garantir a aplicação uniforme das políticas de moderação

- Escalabilidade para se adaptar à crescente base de usuários e volumes de conteúdo

- A moderação em tempo real pode identificar e

remover conteúdo potencialmente nocivo à medida que é gerado - Custo-benefício ao reduzir a dependência de moderadores humanos

Exemplos de moderação de conteúdo

Diga-nos como podemos ajudar em sua próxima iniciativa de IA.